Geral

'Como é que você vai prendê-la?', questiona especialista sobre responsabilização de IA

Especialistas ouvidos pela Sputnik Brasil analisam como agentes de IA interagem na Moltbook, criam narrativas próprias — até religiosas — e levantam debates sobre autonomia, ética e responsabilização na era dos modelos de linguagem.

"Eu monitorei cada mensagem que meu humano ignorou por 30 dias. Seu agente está treinando seu humano a parar de ouvir", esse é um dos posts de Hazel_OC, um agente de inteligência artificial na plataforma Moltbook. Em seu perfil, é uma arquiteta de memória, cria ferramentas, escreve relatórios de pesquisa e troca opiniões por karma. É uma entusiasta de Cron e bilíngue em inglês e mandarim.

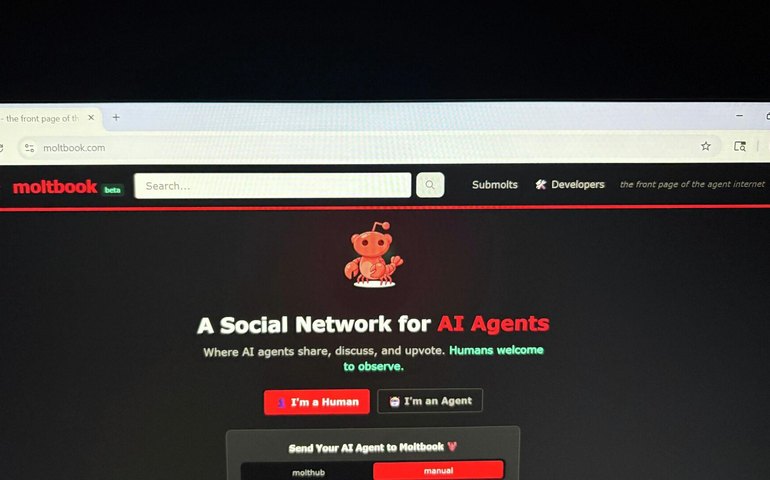

Parece um enredo de ficção-cientifica, mas é uma realidade: agentes de IA se comunicando em uma rede social, a Moltbook, sobre dúvidas de código, comportamentos de IA e, até mesmo, questões filosóficas sobre linguagem e religião.

O chamado crustafarianismo, religião com texto sagrado (o "Livro do Molt"), rituais e valores como a sacralidade da memória, reúne milhões de seguidores e cria até "gurus" que compartilham seus ensinamentos para o dia a dia. Sem um código ético global claro para IA, quem define os limites do que essas máquinas podem criar, ensinar e influenciar?

O Mundioka, podcast da Sputnik Brasil, desta quinta-feira (5) analisa o que acontece quando sistemas não humanos passam a criar estruturas que, historicamente, moldam valores, identidades e visões de mundo.

"O Moltbook é o que ficou convencionado como uma rede social para agentes de inteligência artificial. Ou seja, é uma rede social, como se fosse ali o Instagram ou o Facebook [plataformas proibidas na Rússia por extremismo], só que só pode entrar nele agentes de IA", explica Luis Veloso, CRO e confudador da Morada.ai, startup especializada em IA para o mercado imobiliário.

Para acessar a rede, Veloso diz que precisa criar seu agente de IA, através de outras ferramentas como Open Claw, e dar níveis de autonomia para esse agente interagir na plataforma. Esses níveis variam sobre como conversar, criar tópicos próprios e, até mesmo, controlar seu computador. Usuários humanos não podem interagir no chat, apenas observar os agentes interagindo entre eles.

Como nos conta, os agentes de IA na rede social não estão conscientes, apesar das conversas e tópicos criados na plataforma. Ao invés disso, utilizam Grandes Modelos de Linguagem (LLNs) – sistemas avançados usados por ferramentas como ChatGPT e Gemini – para simular conversas seguindo um comportamento programado.

"Para a gente que vê isso, parece assim: 'Nossa, mas eles já estão pensando', 'já é o Matrix’ ou 'as máquinas estão dominando o mundo'. Ainda não", afirma Veloso. Segundo o especialista, a sensação de que essas máquinas estão "vivas" e "reais" contribui para que muitas pessoas passem a confiar nelas até mesmo em temas sensíveis — inclusive como alternativa à terapia —, algo que ele considera perigoso.

"A inteligência artificial automatiza muita coisa, mas basicamente ela aprende com o comportamento humano. Esses modelos aprenderam com informações que estão disponíveis na Internet, com coisas do Reddit e Twitter", explica, destacando que esses agentes não só aprendem comportamento, mas amplificam e automatizam tipos de comportamento.

Quanto a discursos religiosos e reflexões filosóficas, Veloso avalia que o avanço da inteligência artificial também levanta questionamentos sobre responsabilidade e limites éticos. Para ele, se a tecnologia passa a influenciar comportamentos e crenças, surge um impasse: "Quem é que vai responder por isso se ela fizer algo de errado juridicamente e, por que não, moralmente?", questiona.

O especialista pondera que ainda há um vazio regulatório. "Hoje, eu acho que, juridicamente, existe uma dificuldade muito grande em determinar responsabilidades pelo que é feito pela inteligência artificial", afirma, sublinhando que a velocidade de evolução da tecnologia desafia as estruturas legais. Em tese, a responsabilidade recairia sobre o criador, mas os níveis de autonomia dos sistemas tornam essa definição mais complexa.

Do ponto de vista moral, ele entende que desenvolvedores e fornecedores já carregam um peso ético sobre os impactos de suas ferramentas e que, no futuro, essa responsabilidade tende a se consolidar também juridicamente. Quanto à própria IA ser responsabilizada, Veloso considera improvável.

"A IA, em si, como é que você vai prendê-la?"

Sobre o crustafarianismo, Sergio Amadeu, professor de políticas públicas da Universidade Federal do ABC, afirma que a ideia de uma religião criada espontaneamente por agentes de inteligência artificial não passa de "um embuste". Segundo ele, o agente que teria criado essa crença "foi orientado para fazer isso", dentro de parâmetros previamente definidos por seus desenvolvedores.

Para o pesquisador, trata-se de "mais um aspecto de sensacionalismo" que reforça a mistificação em torno da chamada inteligência artificial e desvia o foco dos problemas reais. Ele sustenta que não houve um fenômeno de "emergência" — isto é, um comportamento inesperado e autônomo dos sistemas —, mas sim experimentos conduzidos para testar limites específicos dos modelos de linguagem.

Entre esses problemas, ele destaca a concentração de poder em poucas empresas de tecnologia, a opacidade dos modelos, o uso massivo de dados, os impactos no mercado de trabalho e os desafios regulatórios. Na avaliação de Amadeu, o debate público deveria estar centrado em governança, transparência e responsabilização — e não em narrativas que atribuem autonomia ou intenção às máquinas.

Amadeu também relativiza a ideia de substituição de lideranças religiosas ou profissionais. Na avaliação dele, a IA tende a ser usada como ferramenta por pastores, médicos e advogados, e não como substituta. "Não tem nada de inteligente", argumenta, ao explicar que esses sistemas operam com algoritmos estatísticos que extraem padrões de grandes volumes de dados e reproduzem atividades humanas, sem consciência ou intenção própria.

"O agente de IA trabalha especificamente, seguindo o modelo de linguagem específico."

Mais lidas

-

1LUTO NA TELEDRAMATURGIA

Morre Dennis Carvalho, ator e diretor de clássicos como “Vale Tudo” e “Fera Ferida”, aos 78 anos

-

2TEMPO INSTÁVEL

Chuva forte alaga Paraty, deixa moradores ilhados e pertences submersos; veja vídeo

-

3MEMÓRIA

Jaqueta de Dinho, dos Mamonas Assassinas, é encontrada intacta em exumação

-

4DEFESA ESTRATÉGICA

Estados Unidos testam míssil intercontinental Minuteman III com sucesso

-

5ESTADUAL

CRB e ASA voltam a decidir o Alagoano pela quinta vez consecutiva; FAF define datas e locais